目录

-

- API说明:

- 思路

- 注意事项

- 完整代码

- 总结

欢迎关注 『Python』 系列,持续更新中

欢迎关注 『Python』 系列,持续更新中

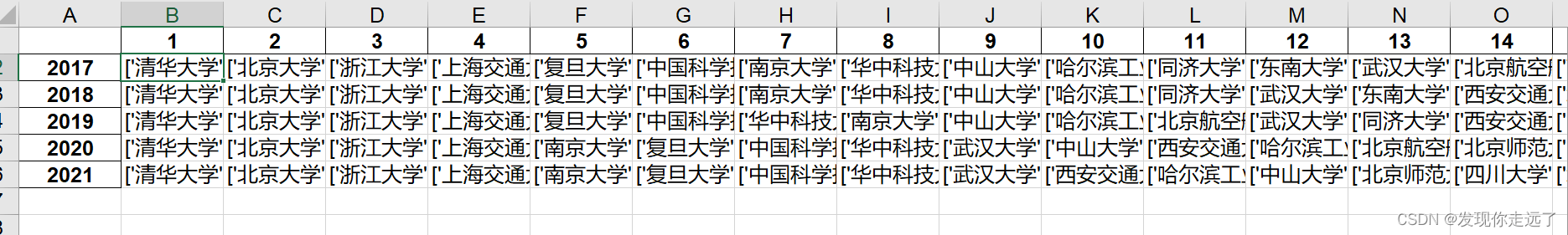

爬取近5年的中国大学排行榜信息,

在python爬虫爬取2021中国大学排名实战【Python】(测试代码+api例程)

在python爬取近5年的中国大学排行榜信息【Python】(测试代码+api例程)

基础上完成,建议先观看前面的文章

API说明:

“%10s %10s %10s” % (“名称”, “分数”, “城市”)

让字符串占位10个位置,占位格式化输出

resp.encoding = ‘utf-8’

一定要加上这句编码格式设定为utf-8,否则会乱码。

不加编码格式会出现下图的情况:

name = tr.xpath(“./td[2]/div/div[2]/div[1]/div/div/a/text()”)[0].replace(" “, “”).replace(”\n", “”)

获取指定xpath节点的文本,取得列表第一项,replace格式化掉多于的空格和换行符

思路

- 导入库

import pandas as pd import numpy as np

- 通过panda库把result列表转为DataFrame类型,并且设置行列的索引

result=pd.DataFrame(result,index=list(np.arange(start_year,end_year+1)),columns=list(np.arange(1,31)))

- to_excel 导出为excel文件

result=pd.DataFrame(result,index=list(np.arange(start_year,end_year+1)),columns=list(np.arange(1,31))) print(result) result.to_excel("爬取近5年的排行榜信息.xls")

——-下面是前面文章的步骤,如果看过可以跳过———

这里先讲与上一文章的区别,就是从遍历一年的数据变成了访问多年的数据。

我们先观察一下2021年排行榜的网站的urlhttps://www.shanghairanking.cn/rankings/bcur/2021

我们再观察一下2022年排行榜的网站的urlhttps://www.shanghairanking.cn/rankings/bcur/2022

这里可以发现区别在于末尾的2021变成了2022

-

所以我们只需要for循环,最近的5年,改变url的末尾年数,重复上一文章的爬取就可以了。

-

这里我们增加代码复用,封装一个函数getYearData输入年份year字符串格式

返回一个result数组

#输入年份year字符串格式 #返回一个result数组 def getYearData(year): url = "https://www.shanghairanking.cn/rankings/bcur/"+year resp = requests.get(url)# 拿到页面源代码 resp.encoding = 'utf-8' # 一定要加上这句编码格式设定,否则会乱码。 html = etree.HTML(resp.text)# 提取和解析数据

# 拿到所有学校的数据集合/html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr # 某个学校的名字 /html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr[1]/td[2]/div/div[2]/div[1]/div/div/a # 某个学校的分数 /html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr[1]/td[5] # 某个学校的城市 /html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr[1]/td[3]/text()

#拿到所有学校的数据集合,这样方便后续的循环for遍历,类似先找到所有对象的集合,然后对每个对象进行统一的提取信息操作 tbody = html.xpath("/html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr") result = [] for tr in tbody: # 每一个学校信息 ls = [] name = tr.xpath("./td[2]/div/div[2]/div[1]/div/div/a/text()")[0].replace(" ", "").replace("\n", "")#学校名 mark = tr.xpath("./td[5]/text()")[0].replace(" ", "").replace("\n", "")#学校分数 city = tr.xpath("./td[3]/text()")[0].replace(" ", "").replace("\n", "")#学校城市 ls.append(name) ls.append(mark) ls.append(city) result.append(ls)

# print("%10s %10s %10s" % ("名称", "分数", "城市")) # for i in result: # print("%10s %10s %12s" % (i[0], i[1], i[2]))#占位输出,这里后续可以继续优化,但是本题重点是爬虫,不再过度深究 return result

- 主代码业务逻辑部分

start_year=2016 end_year=2021 result=[] for i in range(start_year,end_year+1): result.append(getYearData(str(i)))#把每一年的数据加入到result数组中 print(result)#打印数组

- 导入必要的包

import requests from lxml import etree

- 根据url获取页面源码并提取和解析数据(注意,这里一定要记得转化编码格式,否则会乱码!!!)

url = "https://www.shanghairanking.cn/rankings/bcur/2021" resp = requests.get(url)# 拿到页面源代码 resp.encoding = 'utf-8' # 一定要加上这句编码格式设定,否则会乱码。 html = etree.HTML(resp.text)# 提取和解析数据

- 拿到所有学校的数据集合(这里末尾的tr[1]表示取第一个学校,改成tr后表示取所有的tr也就是取所有的学校),这样方便后续的循环for遍历,类似先找到所有对象的集合,然后对每个对象进行统一的提取信息操作

tbody = html.xpath("/html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr")

- 取出信息并且装入result列表,二层列表嵌套

result = [] for tr in tbody: # 每一个学校信息 ls = [] name = tr.xpath("./td[2]/div/div[2]/div[1]/div/div/a/text()")[0].replace(" ", "").replace("\n", "")#学校名 mark = tr.xpath("./td[5]/text()")[0].replace(" ", "").replace("\n", "")#学校分数 city = tr.xpath("./td[3]/text()")[0].replace(" ", "").replace("\n", "")#学校城市 ls.append(name) ls.append(mark) ls.append(city) result.append(ls)

注意事项

完整代码

# @Time : 2022/5/18 22:38 # @Author : 南黎 # @FileName: 3爬取数据并存储在excel中,绘制图表.py

import requests from lxml import etree

#输入年份year字符串格式 #返回一个result数组 def getYearData(year): url = "https://www.shanghairanking.cn/rankings/bcur/"+year resp = requests.get(url)# 拿到页面源代码 resp.encoding = 'utf-8' # 一定要加上这句编码格式设定,否则会乱码。 html = etree.HTML(resp.text)# 提取和解析数据

# 拿到所有学校的数据集合/html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr # 某个学校的名字 /html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr[1]/td[2]/div/div[2]/div[1]/div/div/a # 某个学校的分数 /html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr[1]/td[5] # 某个学校的城市 /html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr[1]/td[3]/text()

#拿到所有学校的数据集合,这样方便后续的循环for遍历,类似先找到所有对象的集合,然后对每个对象进行统一的提取信息操作 tbody = html.xpath("/html/body/div/div/div/div[2]/div/div[3]/div[2]/div[1]/div/div[2]/table/tbody/tr") result = [] for tr in tbody: # 每一个学校信息 ls = [] name = tr.xpath("./td[2]/div/div[2]/div[1]/div/div/a/text()")[0].replace(" ", "").replace("\n", "")#学校名 mark = tr.xpath("./td[5]/text()")[0].replace(" ", "").replace("\n", "")#学校分数 city = tr.xpath("./td[3]/text()")[0].replace(" ", "").replace("\n", "")#学校城市 ls.append(name) ls.append(mark) ls.append(city) result.append(ls)

# print("%10s %10s %10s" % ("名称", "分数", "城市")) # for i in result: # print("%10s %10s %12s" % (i[0], i[1], i[2]))#占位输出,这里后续可以继续优化,但是本题重点是爬虫,不再过度深究 return result

start_year=2017 end_year=2021 result=[] for i in range(start_year,end_year+1): result.append(getYearData(str(i)))#把每一年的数据加入到result数组中 print(result)#打印数组

import pandas as pd import numpy as np result=pd.DataFrame(result,index=list(np.arange(start_year,end_year+1)),columns=list(np.arange(1,31))) print(result) result.to_excel("爬取近5年的排行榜信息.xls")

总结

大家喜欢的话,给个👍,点个关注!继续跟大家分享敲代码过程中遇到的问题!

版权声明:

发现你走远了@mzh原创作品,转载必须标注原文链接

Copyright 2022 mzh

Crated:2022-1-10

欢迎关注 『Python』 系列,持续更新中

欢迎关注 『Python』 系列,持续更新中

【Python安装第三方库一行命令永久提高速度】

【使用PyInstaller打包Python文件】

【更多内容敬请期待】

神龙|纯净稳定代理IP免费测试>>>>>>>>天启|企业级代理IP免费测试>>>>>>>>IPIPGO|全球住宅代理IP免费测试